Physical Address

304 North Cardinal St.

Dorchester Center, MA 02124

Physical Address

304 North Cardinal St.

Dorchester Center, MA 02124

O mercado de hardware em 2026 vive um de seus momentos mais tensos e economicamente proibitivos para o consumidor final. Se você tentou montar um PC ou fazer um upgrade recentemente, sentiu no bolso o impacto da crise nos preços de memória RAM e SSDs disparando em uma velocidade alarmante.

O grande culpado por esse cenário é o apetite voraz dos data centers de inteligência artificial, que estão monopolizando a produção global de chips DRAM, HBM e NAND para sustentar seus modelos.

O Google anunciou o TurboQuant, uma técnica de compressão que promete fazer com que os modelos de linguagem consumam menos memória para realizar as mesmas tarefas, sem precisar de um único chip novo, sendo possivelmente uma saída para a atual crise.

–

Entre no Canal do WhatsApp do Canaltech e fique por dentro das últimas notícias sobre tecnologia, lançamentos, dicas e tutoriais incríveis.

–

Para entender essa virada de jogo, primeiro precisamos olhar para o KV cache, ou Key-Value cache. Em termos simples, ele funciona como um rascunho interno que as IAs utilizam durante uma conversa. Toda vez que você interage com um modelo, como ChatGPT ou Gemini, por exemplo, ele precisa processar o contexto anterior para gerar a próxima palavra.

Em vez de recalcular todo o histórico do zero a cada novo termo gerado, o modelo consulta esse rascunho guardado na memória para responder de forma quase instantânea. O principal problema é que esse cache cresce proporcionalmente ao tamanho do contexto e ao número de usuários simultâneos, transformando-se em um verdadeiro devorador de memória RAM e VRAM das placas de vídeo.

No cenário atual da IA, a capacidade de computação bruta deixou de ser o único grande problema, e a memória tornou-se o principal gargalo da indústria, mais especificamente no segmento de servidores. Quanto maior o documento ou a conversa que a IA precisa processar, mais dados o sistema deve manter acessíveis instantaneamente.

Em data centers, com milhões de sessões acontecendo ao mesmo tempo, essa conta explode e pressiona as Big Techs a comprarem todos os chips de memória disponíveis no planeta para evitar lentidão. Esse cenário ajuda a entender por que a demanda por IA mexeu tão forte com o mercado global, já que a necessidade de expandir o hardware para suportar contextos longos criou um desequilíbrio entre oferta e demanda que afetou até os componentes domésticos.

O TurboQuant surge como a resposta técnica do Google para aliviar esse peso. O que ele faz é aplicar um processo de quantização extrema para reduzir a precisão numérica dos dados guardados no cache sem destruir a inteligência das respostas. Ao combinar as tecnologias PolarQuant e QJL para mitigar erros, o Google afirma que é possível comprimir o KV cache para cerca de 3 bits sem perda perceptível de precisão.

O resultado prático é impressionante, já que permite ocupar pelo menos seis vezes menos memória para o cache e entregar até oito vezes mais velocidade em processamento de longo contexto.

Se cada instância de IA passar a precisar de apenas uma fração da memória anterior para manter o contexto, um data center poderá atender muito mais usuários com a mesma quantidade de RAM e VRAM instalada.

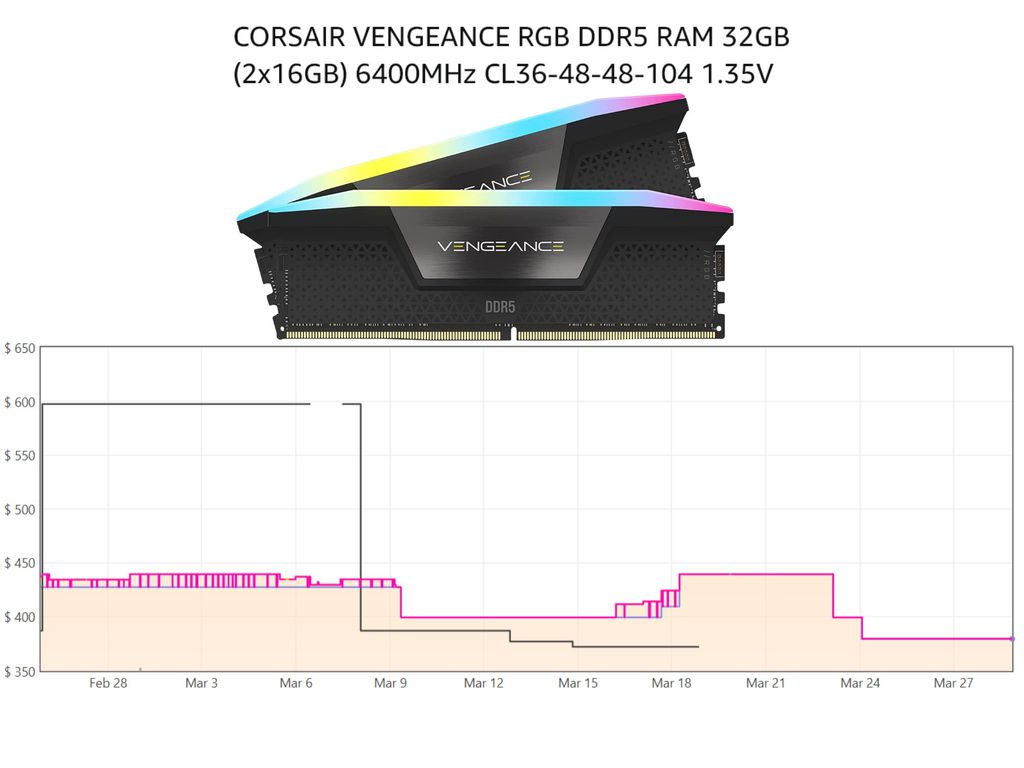

Isso reduz drasticamente a urgência das gigantes de tecnologia por módulos caros de alta capacidade para escalar suas operações. Foi justamente essa novidade recente que fez o mercado financeiro reagir imediatamente, provocando uma queda nas ações de empresas do setor de memórias, como a Micron, logo após a divulgação do TurboQuant, já que a necessidade de compras de chips em grandes volumes pode diminuir a curto prazo.

Apesar do otimismo, é necessário ter cuidado com as expectativas imediatas para o consumidor comum, pois isso ainda não significa que veremos memórias baratas nas prateleiras amanhã. O efeito imediato do anúncio foi muito mais voltado para o sentimento do mercado financeiro e para o planejamento estratégico de grandes corporações do que para o varejo, apesar de algumas quedas isoladas já terem começado.

Ainda existe uma demanda estrutural enorme e uma crise de produção que não se resolve apenas com uma nova técnica de compressão de dados. No entanto, se a técnica for amplamente adotada pela indústria, ela tem o potencial real de aliviar a pressão a médio prazo.

Os componentes que devem sentir esse impacto primeiro são as memórias de alto desempenho usadas em servidores, como as memórias HBM. O impacto na memória de vídeo das placas profissionais também será direto, permitindo que modelos maiores rodem em hardwares menos robustos.

O consumidor sentirá esse reflexo de forma indireta e somente depois, apenas quando a pressão de demanda sobre as fábricas de DRAM convencional começar a ceder. A crise atual envolve muitas camadas, incluindo a produção de SSDs, mas a redução da demanda das IAs por memória é o primeiro passo fundamental para que a oferta global volte a um estado de equilíbrio.

O TurboQuant não resolve sozinho a crise de memória de 2026, mas ele representa um marco importante ao confrontar diretamente o motivo técnico que transformou a IA em uma máquina que devora memória. Ele prova que a otimização de software é uma ferramenta tão poderosa quanto a construção de novas fábricas de semicondutores.

Se a adoção dessa tecnologia se tornar o padrão da indústria, poderemos olhar para esse momento como o início do fim do superaquecimento de preços que tornou o hardware de alto desempenho um artigo de luxo inacessível para muitos.

Leia a matéria no Canaltech.